Trong thời đại bùng nổ của trí tuệ nhân tạo (AI), việc bảo vệ thông tin cá nhân trở nên quan trọng hơn bao giờ hết. Các công ty AI đang liên tục thu thập dữ liệu, cả công khai và cá nhân, để huấn luyện và cải thiện mô hình của họ. Tuy nhiên, quá trình này có thể đặt quyền riêng tư của chúng ta vào rủi ro. Bài viết này sẽ phân tích chính sách bảo mật của các chatbot và dịch vụ AI phổ biến, đồng thời đề xuất các cách để bảo vệ quyền riêng tư của bạn.

Contents

- Các Chatbot AI Phổ Biến Xử Lý Dữ Liệu Của Bạn Như Thế Nào?

- Google Gemini (Tên cũ là Bard)

- Chính Sách Lưu Trữ Dữ Liệu

- OpenAI ChatGPT

- Microsoft Copilot

- Remini, Runway và Nhiều Ứng Dụng Khác

- Chia Sẻ Dữ Liệu Với Bên Thứ Ba

- Rủi ro Của Dữ Liệu Cá Nhân Trong Tập Dữ Liệu Huấn Luyện

- Có Cơ Chế Từ Chối Tham Gia Không?

- Các Giải Pháp Thay Thế Là Gì?

- Kết Luận

Các Chatbot AI Phổ Biến Xử Lý Dữ Liệu Của Bạn Như Thế Nào?

Google Gemini (Tên cũ là Bard)

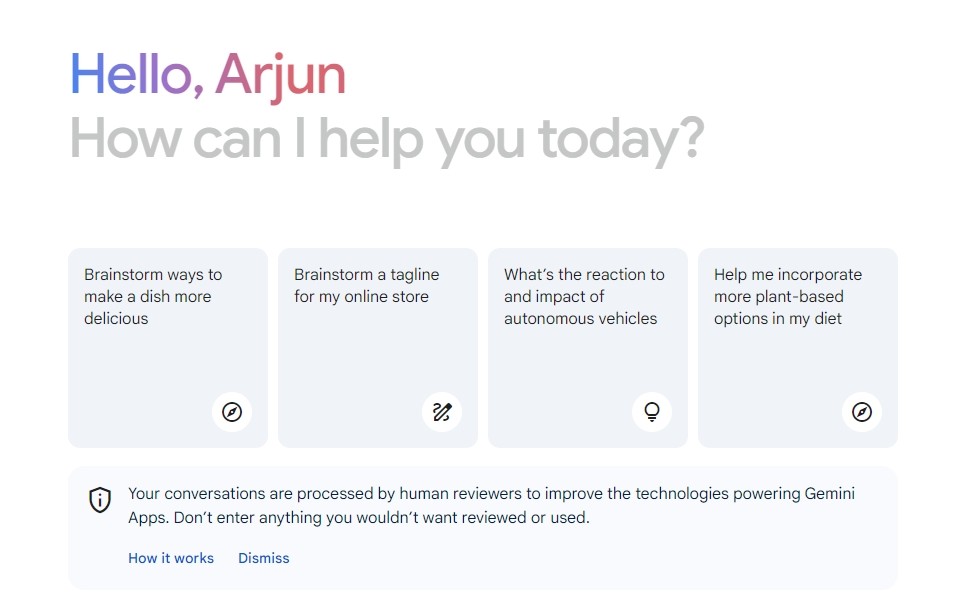

Trang chủ Gemini

Trang chủ Gemini

Google Gemini lưu trữ tất cả dữ liệu hoạt động của bạn theo mặc định, không yêu cầu sự đồng ý rõ ràng của người dùng. Google cho biết dữ liệu này được lưu trữ trong tối đa 18 tháng. Hơn nữa, các cuộc trò chuyện trên Gemini được xử lý bởi người đánh giá, họ đọc và chú thích cuộc hội thoại để cải thiện mô hình AI của Google.

Google cũng yêu cầu người dùng không chia sẻ bất kỳ thông tin bí mật hoặc cá nhân nào mà họ không muốn người đánh giá xem hoặc Google sử dụng. Ngoài cuộc hội thoại, vị trí, địa chỉ IP, loại thiết bị và địa chỉ nhà/cơ quan từ tài khoản Google của bạn cũng được lưu trữ.

Chính Sách Lưu Trữ Dữ Liệu

Google tuyên bố dữ liệu của bạn được ẩn danh bằng cách tách tài khoản Google khỏi cuộc hội thoại. Google cũng cung cấp tùy chọn tắt Hoạt động Gemini và cho phép bạn xóa tất cả dữ liệu liên quan. Tuy nhiên, ngay cả khi bạn xóa dữ liệu, Google vẫn giữ lại dữ liệu đã được đánh giá trong ba năm.

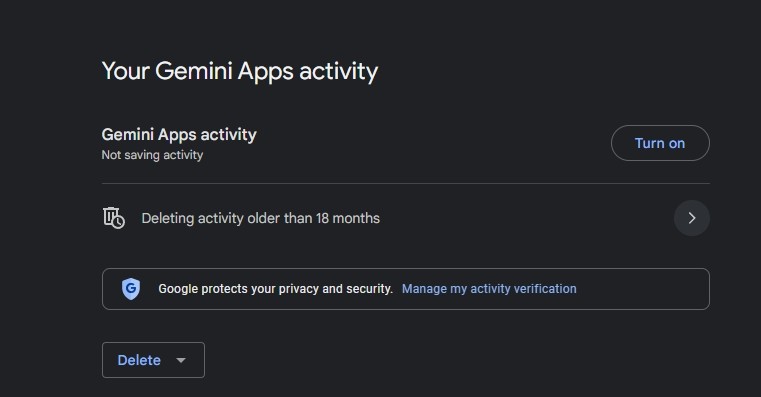

Tắt hoạt động ứng dụng Gemini

Tắt hoạt động ứng dụng Gemini

Ngay cả khi Hoạt động Gemini bị tắt, Google vẫn lưu trữ cuộc hội thoại của bạn trong 72 giờ để ” cung cấp dịch vụ và xử lý bất kỳ phản hồi nào “. Đối với hình ảnh được tải lên, Google cho biết thông tin văn bản được diễn giải từ hình ảnh được lưu trữ, chứ không phải bản thân hình ảnh. Tuy nhiên, điều này có thể thay đổi trong tương lai.

Nếu bạn đã bật tiện bị mở rộng Google Workspace trong Gemini, dữ liệu cá nhân được truy cập từ Gmail, Google Drive và Docs sẽ không qua người đánh giá và không được sử dụng để huấn luyện mô hình AI. Tuy nhiên, dữ liệu này được lưu trữ cho đến ” thời gian cần thiết để cung cấp và duy trì dịch vụ Gemini “. Lưu ý rằng các tiện bị mở rộng khác như Google Flights, Google Hotels, Google Maps và YouTube, các cuộc hội thoại liên quan được xem xét bởi con người.

OpenAI ChatGPT

Tương tự Gemini, ChatGPT cũng lưu tất cả các cuộc hội thoại theo mặc định. Nhưng không giống như Gemini, nó chỉ thông báo cho người dùng mới không chia sẻ thông tin nhạy cảm khi đăng ký lần đầu. Không có biểu ngữ tĩnh trên trang chủ thông báo cho người dùng rằng dữ liệu của họ có thể được sử dụng để xem xét cuộc hội thoại hoặc huấn luyện mô hình.

ChatGPT thu thập cuộc hội thoại, hình ảnh, tệp và nội dung từ Dall-E để huấn luyện mô hình và cải thiện hiệu suất. Bên cạnh đó, OpenAI cũng thu thập địa chỉ IP, dữ liệu sử dụng, thông tin thiết bị, dữ liệu vị trí địa lý, v.v. Điều này áp dụng cho cả người dùng ChatGPT miễn phí và người dùng ChatGPT Plus trả phí. Nội dung từ gói doanh nghiệp như ChatGPT Team, ChatGPT Enterprise và API Platform không được sử dụng để huấn luyện và cải thiện mô hình.

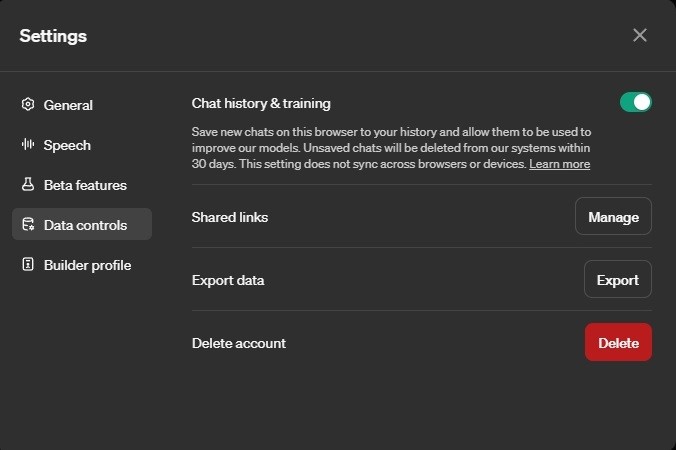

Cài đặt kiểm soát dữ liệu ChatGPT

Cài đặt kiểm soát dữ liệu ChatGPT

OpenAI cho phép bạn tắt lịch sử trò chuyện và huấn luyện trong ChatGPT từ Cài đặt -> Kiểm soát dữ liệu. Tuy nhiên, cài đặt này không đồng bộ với các trình duyệt và thiết bị khác. Khi bạn tắt lịch sử trò chuyện, các cuộc trò chuyện mới sẽ không xuất hiện trong thanh bên và sẽ không được sử dụng để huấn luyện mô hình. Tuy nhiên, OpenAI sẽ giữ lại các cuộc trò chuyện trong 30 ngày để theo dõi lạm dụng.

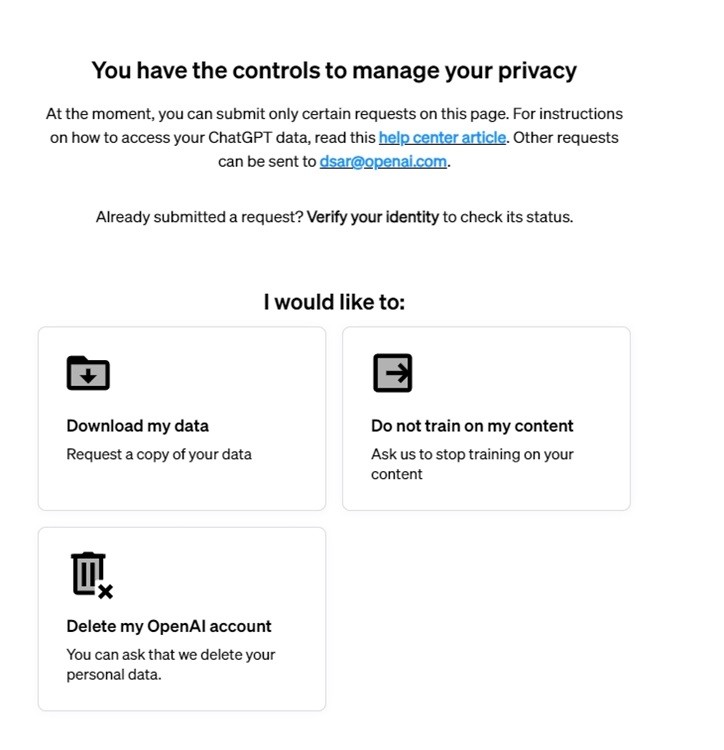

Trang kiểm soát quyền riêng tư OpenAI

Trang kiểm soát quyền riêng tư OpenAI

Giống như Google, OpenAI cũng sử dụng người đánh giá để xem cuộc hội thoại và huấn luyện/cải thiện mô hình của họ theo mặc định. Bạn có thể yêu cầu OpenAI ngừng huấn luyện trên nội dung của mình trong khi vẫn giữ nguyên tính năng Lịch sử trò chuyện. Tuy nhiên, OpenAI không cung cấp quyền truy cập vào cổng thông tin quyền riêng tư này trên trang Cài đặt.

Microsoft Copilot

Chính sách bảo mật của Microsoft Copilot khá phức tạp. Nó không nêu rõ những dữ liệu cá nhân nào được thu thập và cách Microsoft xử lý dữ liệu đó.

Trang chủ Microsoft Copilot

Trang chủ Microsoft Copilot

Bạn có thể xóa tất cả lịch sử hoạt động của Copilot từ trang tài khoản Microsoft, nhưng không có cài đặt để tắt cá nhân hóa hay lịch sử trò chuyện trên trang Copilot. Điểm tích cực duy nhất là Copilot không cá nhân hóa tương tác của bạn nếu cho rằng lời nhắc nhạy cảm và không lưu cuộc hội thoại nếu thông tin có vẻ riêng tư.

Đối với người dùng Copilot Pro, Microsoft sử dụng dữ liệu từ ứng dụng Office để cung cấp trải nghiệm AI mới. Nếu bạn muốn tắt tính năng này, hãy tắt Trải nghiệm được kết nối từ bất kỳ ứng dụng Office nào.

Remini, Runway và Nhiều Ứng Dụng Khác

Remini, một trong những ứng dụng nâng cao ảnh AI phổ biến nhất, có chính sách bảo mật khá mơ hồ. Dữ liệu cá nhân được lưu giữ từ 2 đến 10 năm, mặc dù hình ảnh, video và bản ghi âm thanh bị xóa khỏi máy chủ sau 15 ngày. Tương tự, Runway, một công cụ AI phổ biến xử lý hình ảnh và video, lưu giữ dữ liệu trong tối đa ba năm.

Để tránh những dịch vụ này, hãy tìm kiếm các công cụ hình ảnh AI có thể chạy cục bộ như SuperImage và Upscayl.

Chia Sẻ Dữ Liệu Với Bên Thứ Ba

Google không đề cập liệu người đánh giá xử lý cuộc hội thoại là nhân viên nội bộ hay nhà cung cấp bên thứ ba. Trong khi đó, OpenAI công khai đề cập đến việc sử dụng cả người đánh giá nội bộ và nhà cung cấp dịch vụ bên thứ ba đáng tin cậy để xem và xử lý nội dung, mặc dù dữ liệu được ẩn danh. Cả Google và OpenAI đều khẳng định không bán dữ liệu cho bên thứ ba và cuộc hội thoại không được sử dụng cho mục đích tiếp thị.

Rủi ro Của Dữ Liệu Cá Nhân Trong Tập Dữ Liệu Huấn Luyện

Việc dữ liệu cá nhân lọt vào tập dữ liệu huấn luyện có nhiều rủi ro, bao gồm vi phạm quyền riêng tư cá nhân, rò rỉ dữ liệu mật và đầu độc dữ liệu. Năm ngoái, Samsung đã cấm nhân viên sử dụng ChatGPT do chatbot này rò rỉ dữ liệu nhạy cảm về công ty. Đầu độc dữ liệu cũng là một rủi ro nghiêm trọng, khi kẻ tấn công có thể thêm dữ liệu độc hại vào cuộc hội thoại, làm sai lệch đầu ra của mô hình và gây ra những thiên kiến nguy hiểm.

Có Cơ Chế Từ Chối Tham Gia Không?

Mặc dù các nhà cung cấp dịch vụ lớn như Google và OpenAI cung cấp cho người dùng cách từ chối huấn luyện mô hình, nhưng trong quá trình này, họ cũng vô hiệu hóa lịch sử trò chuyện. OpenAI cho phép người dùng từ chối huấn luyện mô hình mà không mất lịch sử trò chuyện, nhưng tính năng này không được quảng cáo rõ ràng. Google không cung cấp tùy chọn nào như vậy.

Các Giải Pháp Thay Thế Là Gì?

Để giảm thiểu dấu vết dữ liệu của bạn, bạn có thể tắt lịch sử trò chuyện hoặc chạy các mô hình ngôn ngữ lớn (LLM) cục bộ trên máy tính của mình. Có nhiều mô hình nguồn mở chạy trên Windows, macOS và Linux. Bạn cũng có thể chạy mô hình Gemma nhỏ của Google trên máy tính của mình cục bộ hoặc sử dụng PrivateGPT để xử lý tài liệu riêng tư ngoại tuyến.

-

Tôi có thể làm gì để bảo vệ quyền riêng tư khi sử dụng chatbot AI? Hãy tắt lịch sử trò chuyện, sử dụng các mô hình AI cục bộ, và hạn chế chia sẻ thông tin cá nhân.

-

Dữ liệu của tôi được lưu trữ trong bao lâu? Thời gian lưu trữ dữ liệu khác nhau tùy theo từng nhà cung cấp dịch vụ, từ vài ngày đến vài năm.

-

Rủi ro của việc dữ liệu cá nhân bị sử dụng để huấn luyện AI là gì? Rủi ro bao gồm vi phạm quyền riêng tư, rò rỉ dữ liệu và đầu độc dữ liệu.

-

Tôi có thể từ chối cho phép dữ liệu của mình được sử dụng để huấn luyện AI không? Một số nhà cung cấp dịch vụ cho phép bạn từ chối, nhưng điều này có thể ảnh hưởng đến một số tính năng.

-

Có giải pháp thay thế nào cho các chatbot AI phổ biến không? Có, bạn có thể sử dụng các mô hình AI nguồn mở chạy cục bộ trên máy tính của mình.

-

Tại sao việc bảo vệ quyền riêng tư trong thời đại AI lại quan trọng? Vì dữ liệu cá nhân của bạn có thể bị sử dụng sai mục đích hoặc bị rò rỉ, gây ảnh hưởng đến cuộc sống của bạn.

-

Làm thế nào để tôi biết liệu một chatbot AI có đáng tin cậy hay không? Hãy tìm hiểu về chính sách bảo mật của họ và xem xét các đánh giá từ người dùng khác.

Kết Luận

Trong cuộc đua AI ngày nay, việc bảo vệ dữ liệu cá nhân là trách nhiệm của mỗi chúng ta. Người dùng nên tránh cung cấp hoặc tải lên dữ liệu cá nhân trên các dịch vụ AI. Các công ty AI nên ưu tiên quyền riêng tư của người dùng và cung cấp các tùy chọn bảo vệ dữ liệu rõ ràng và dễ sử dụng. Afropolitan Group khuyến khích bạn tìm hiểu và áp dụng các biện pháp bảo vệ quyền riêng tư cần thiết trong thời đại kỹ thuật số này.